Премиальное программное обеспечение и практические уроки

Инструмент искусственного интеллекта для прямой трансляции с изменением лица

Внимание: Не используйте этот инструмент для незаконной деятельности. Все последствия вы несете на свой страх и риск.

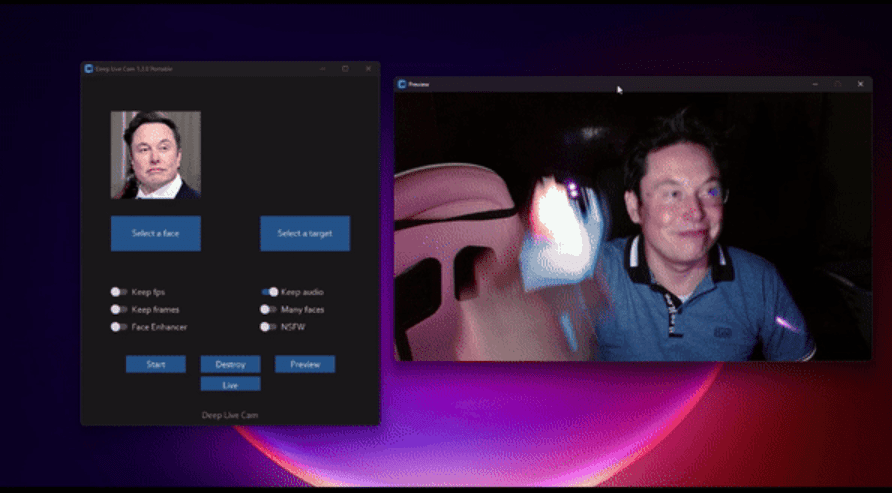

Deep Live Cam — это простой в использовании инструмент для замены лиц на изображениях или видео лицами с указанной фотографии. Он поддерживает процессоры, видеокарты и компьютеры Mac. Deep Live Cam — это инструмент для замены лиц в режиме реального времени на базе искусственного интеллекта, который мгновенно заменяет лицо пользователя во время видеозвонка или прямой трансляции. Эта технология использует передовые алгоритмы глубокого обучения и технологию распознавания лиц для создания реалистичных эффектов «дипфейка» в режиме реального времени, позволяя пользователям выдавать себя за других людей во время видеозвонка.

Благодаря открытому исходному коду этот инструмент широко использовался и обсуждался. Хотя он может быть законно использован в некоторых творческих сценариях, таких как создание виртуальных персонажей или производство медиаконтента, он также поднимает вопросы конфиденциальности и этики, особенно связанные с потенциальными рисками, такими как кража личных данных и мошенничество. Чтобы предотвратить злоупотребления, разработчики пытаются внедрить механизмы проверки контента для защиты конфиденциальности пользователей.

Deep-Live-CamОсновная ценность заключается в широком спектре применения. Художники могут использовать его для анимации персонажей или использовать их в качестве моделей для дизайна одежды. Кроме того, он потенциально применим в постпродакшне фильмов и телепередач, для виртуальных ведущих, образовательных презентаций и других областях, значительно расширяя возможности создания контента.

Deep-Live-CamОсновная ценность заключается в широком спектре применения. Художники могут использовать его для анимации персонажей или использовать их в качестве моделей для дизайна одежды. Кроме того, он потенциально применим в постпродакшне фильмов и телепередач, для виртуальных ведущих, образовательных презентаций и других областях, значительно расширяя возможности создания контента.

Страница проекта GitHub:https://github.com/hacksider/Deep-Live-Cam

Бесплатное заявление о Deep Live Cam

Целью данного программного обеспечения является внесение вклада в индустрию медиа на основе ИИ и оказание помощи художникам в решении таких задач, как анимация пользовательских персонажей или использование их в качестве моделей одежды.

Мы осознаём потенциальные риски, связанные с неэтичными приложениями, и стремимся принимать превентивные меры. Встроенные проверки предотвращают обработку программой ненадлежащих медиафайлов (изображений обнажённой натуры, графического контента, деликатных материалов, таких как военные кадры, и т. д.). Мы продолжим ответственно развивать проект, соблюдая юридические и этические нормы. Мы можем закрыть проект или добавить водяной знак, если это требуется по закону.

Пользователи должны использовать это программное обеспечение ответственно и в рамках закона. При использовании реальных лиц, пожалуйста, получите их согласие и четко указывайте, что любой результат является дипфейком, при публикации в интернете. Мы не несем ответственности за действия конечных пользователей.

Подготовка перед установкой

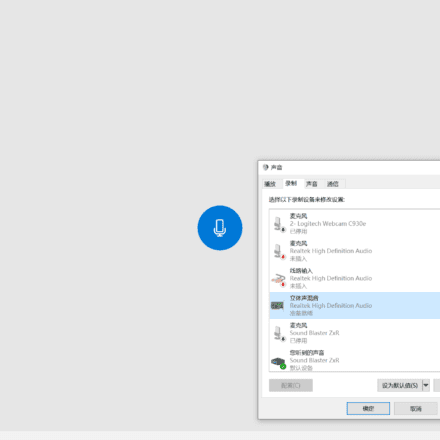

Необходимо установить N-карту CUDA

Адрес для скачивания:https://developer.nvidia.com/cuda-downloads/

Должна быть установлена видеокарта AMD AMD HIP SDK

Скачать

- https://pan.quark.cn/s/f5f86d769394

- https://drive.uc.cn/s/eab589fe1a1d4

- https://pan.baidu.com/s/1c65OrFR18AuHOvTH56Yu7Q?pwd=6666

Коллекция библиотек Microsoft Common Runtime 2024.08.14

- https://pan.quark.cn/s/e4bcf05899c9

- https://pan.baidu.com/share/init?surl=hlSdsPD-H1FgD2IFanLJWA&pwd=6666

Библиотеку времени выполнения также можно установить:Коллекция игрового программного обеспечения (2024.10.01) Унифицированная игровая улучшенная среда выполнения

Установка Deep Live Cam

Если на вашем компьютере с Windows установлена видеокарта Nvidia, вы можете загрузить ее напрямую и использовать сразу после загрузки.

Просто скачайте, распакуйте и запустите. Эта версия поставляется в виде самораспаковывающегося архива, что избавляет от необходимости сложной установки.

Основные характеристики

- Простая настройка: попрощайтесь с утомительными этапами установки, просто скачайте, распакуйте и сразу же запустите.

- Оптимизированная производительность: наслаждайтесь плавными эффектами в реальном времени на совместимых графических процессорах NVIDIA.

- Удобный интерфейс: интуитивно понятный дизайн делает использование простым для пользователей любого уровня подготовки.

Системные требования

NVIDIA GPU: требуется 6 ГБ или более видеопамяти (рекомендуется для оптимальной производительности).

Инструментарий CUDA 11.8.

Операционная система: Windows 10 или Windows 11.

Память: рекомендуется 16 ГБ.

Примечание: эта версия имеет ту же функциональность, что и версия на GitHub, но обеспечивает более удобный интерфейс для пользователей.

Загрузите пакет интеграции Deep Live Cam

Загрузите готовый пакет. Я сделал интегрированные пакеты для видеокарт N и A. Если объём памяти вашей видеокарты меньше 8 ГБ, не скачивайте его!

https://pan.quark.cn/s/bad0d6cd6f0d

Загрузите и установите пакет интеграции

Ниже представлен пакет интеграции установки, поддерживающий установку ЦП и установку графического процессора.

Размер пакета составляет 6,46 ГБ. Пакет уже включает Python и его зависимые пакеты, ffmpeg и установочные скрипты окружения vsc.

https://pan.baidu.com/s/1OzvIzV80rDMZALzUGazHpA?pwd=iaim

Дважды щелкните соответствующий файл запуска .bat в зависимости от того, какой процессор вы хотите запустить — CPU или GPU.

После запуска откроется интерфейс приложения. Выберите слева изображение лица, которое хотите имитировать, и справа — изображение, которое хотите конвертировать. Нажмите «Начать» (конвертировать изображение) или нажмите «Вживую», не загружая изображение.Замена лиц в реальном времени.

Инструкция по установке Deep Live Cam

Ручная установка Deep-Live-Cam может выполняться немного медленно при использовании центрального процессора. Рекомендуется использовать версию для графического процессора.

Установка Deep-Live-Cam относительно проста, но требует определённой конфигурации компьютерной среды, включая Python 3.10, pip, git и ffmpeg. Для завершения установки пользователи могут клонировать репозиторий GitHub, загрузить и разместить файлы модели, а также установить зависимости. Программа поддерживает несколько провайдеров выполнения, включая CPU, CUDA (видеокарты Nvidia), CoreML (Apple Silicon), DirectML (Windows) и OpenVINO (Intel). Пользователи могут выбрать подходящий провайдер выполнения в зависимости от своих аппаратных требований.

Предпосылки

- Питон(рекомендуется 3.10)

- пип

- мерзавец

- ffmpeg

- Среда выполнения Visual Studio 2022 (Windows)

Среды выполнения Visual Studio 2022 (Windows) Выберите нужную версию в Visual C++ Redistributable для Visual Studio 2022

https://learn.microsoft.com/en-us/cpp/windows/latest-supported-vc-redist

Загрузите установочный пакет 64-битной версии прямо здесь: https://aka.ms/vs/17/release/vc_redist.x64.exe

Руководство по установке Visual Studio 2022 Professional Edition

Вам необходимо использовать научное интернет-соединение. Если у вас возникли проблемы с медленной или недоступной загрузкой PyTorch, попробуйте другой прокси-узел и повторите попытку.

Шаги ручной установки

Ручная установка подходит экспертам, которые любят повозиться. Новичкам рекомендуется использовать готовую версию.

Клонируйте проект Deep-Live-Cam с помощью Git

Клонируйте репозиторий GitHub, который загрузит код проекта Deep-Live-Cam на ваш локальный компьютер.

git-клон https://github.com/hacksider/Deep-Live-Cam.git

Войдите в каталог проекта, чтобы выполнить последующие команды в каталоге.

cd Deep-Live-Cam

Установка зависимостей

Создайте новую среду Conda deeplivecam и укажите версию Python 3.10, чтобы изолировать зависимости проекта.

conda create -n deeplivecam python=3.10 -y

Активируйте только что созданную вами среду Conda для запуска Python и установки в ней зависимостей.

conda активировать deeplivecam

Установите зависимости проекта, перечисленные в файле requirements.txt.

pip install -r requirements.txt

Скачать модель

Загрузите обе модели в папку /models в корневом каталоге проекта. Ссылка для скачивания:

- inswapper_128_fp16.onnx:https://huggingface.co/hacksider/deep-live-cam/resolve/main/inswapper128fp16.onnx

- ПРИМЕЧАНИЕ: Если у вас возникли проблемы с inswapper_128_fp16.onnx, используйте эту альтернативную версию:https://github.com/facefusion/facefusion-assets/releases/download/models/inswapper_128_fp16.onnx

- GFPGANv1.4:https://huggingface.co/hacksider/deep-live-cam/resolve/main/GFPGANv1.4.pth

- Поместите эти файлы в папку «models».

Как использовать версию GPU

Шаги по использованию графического процессора

Удалите установленные onnxruntime и onnxruntime-gpu, так как вам нужно указать конкретную версию

pip uninstall onnxruntime onnxruntime-gpu

Установите указанную версию onnxruntime-gpu, чтобы обеспечить совместимость с версией CUDA проекта.

pip install onnxruntime-gpu==1.16.3

Используйте CUDA для выполнения основного скрипта проекта run.py и ускорения GPU.

python python run.py --execution-provider cuda

Как использовать версию CPU

Для начала просто выполните следующую команду:

python run.py

Сценарии использования

- Замена якорного лица

- Подмена лиц на видео для защиты конфиденциальности