Hervorragende Software und praktische Tutorials

KI-basiertes Live-Broadcast-Tool zur Gesichtsveränderung

Warnung: Verwenden Sie dieses Tool nicht für illegale Aktivitäten. Sie tragen die alleinige Verantwortung für alle daraus entstehenden Folgen.

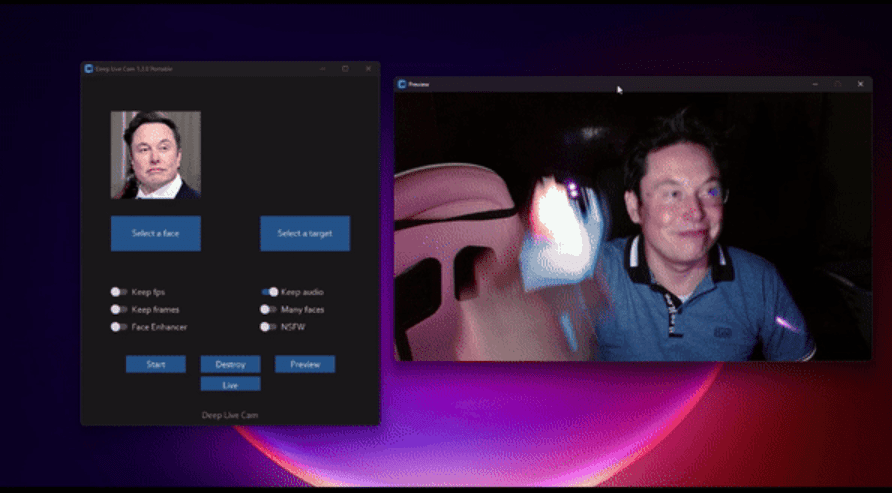

Deep Live Cam ist ein benutzerfreundliches Tool zur Gesichtsveränderung, das das Gesicht im Bild/Video durch das Gesicht auf dem von Ihnen angegebenen Foto ersetzen kann. Es unterstützt CPU-, GPU- und Mac-Umgebungen. Deep Live Cam ist ein KI-basiertes Echtzeit-Tool zur Gesichtsveränderung, das das Gesicht des Benutzers in einem Videoanruf oder einer Live-Übertragung sofort ersetzen kann. Diese Technologie nutzt fortschrittliche Deep-Learning-Algorithmen und Gesichtserkennungstechnologie, um realistische Echtzeit-Deepfake-Effekte zu erzeugen, die es Benutzern ermöglichen, in einem Videoanruf eine andere Person zu spielen.

Dieses Tool wird aufgrund seines Open-Source-Charakters häufig verwendet und diskutiert. Obwohl es in bestimmten kreativen Szenarien, beispielsweise bei der Erstellung virtueller Charaktere oder der Medienproduktion, legitime Anwendungsmöglichkeiten bietet, wirft es auch datenschutzrechtliche und ethische Fragen auf, insbesondere im Hinblick auf potenzielle Risiken wie Identitätsdiebstahl und Betrug. Um Missbrauch zu verhindern, haben Entwickler versucht, Mechanismen zur Inhaltsüberprüfung einzuführen, um die Privatsphäre der Nutzer zu schützen.

Deep-Live-CamDer Kernwert von KI liegt in ihren vielfältigen Anwendungsszenarien. Künstler können damit benutzerdefinierte Charaktere mit Animationseffekten versehen oder Figuren als Modelle für Kleidungsdesigns verwenden. Darüber hinaus kann KI auch in der Postproduktion von Film und Fernsehen, als virtuelle Moderatorin, in Bildungspräsentationen und anderen Bereichen eingesetzt werden und erweitert so die Möglichkeiten der Inhaltserstellung erheblich.

Deep-Live-CamDer Kernwert von KI liegt in ihren vielfältigen Anwendungsszenarien. Künstler können damit benutzerdefinierte Charaktere mit Animationseffekten versehen oder Figuren als Modelle für Kleidungsdesigns verwenden. Darüber hinaus kann KI auch in der Postproduktion von Film und Fernsehen, als virtuelle Moderatorin, in Bildungspräsentationen und anderen Bereichen eingesetzt werden und erweitert so die Möglichkeiten der Inhaltserstellung erheblich.

GitHub-Projektseite:https://github.com/hacksider/Deep-Live-Cam

Deep Live Cam – Kostenloser Anspruch

Die Software soll einen nützlichen Beitrag zur KI-Medienbranche leisten. Sie soll Künstlern beispielsweise bei der Animation individueller Charaktere oder deren Verwendung als Kleidungsmodelle helfen.

Wir sind uns der potenziellen Risiken unethischer Anwendungen bewusst und ergreifen daher präventive Maßnahmen. Integrierte Kontrollen verhindern, dass das Programm unangemessene Medien (Nacktheit, grafische Inhalte, sensibles Material wie Kriegsaufnahmen usw.) verarbeitet. Wir werden das Projekt verantwortungsvoll und unter Einhaltung rechtlicher und ethischer Standards weiterentwickeln. Wir behalten uns das Recht vor, das Projekt einzustellen oder ein Wasserzeichen hinzuzufügen, falls dies gesetzlich vorgeschrieben ist.

Nutzer sollten die Software verantwortungsbewusst und legal nutzen. Wenn Sie echte Gesichter verwenden, holen Sie bitte deren Zustimmung ein und kennzeichnen Sie alle Ergebnisse beim Online-Teilen deutlich als Deepfake. Wir übernehmen keine Verantwortung für die Handlungen von Endnutzern.

Vorbereitung vor der Installation

N-Karte CUDA muss installiert sein

Downloadadresse:https://developer.nvidia.com/cuda-downloads/

AMD-Grafikkarte AMD HIP SDK muss installiert sein

Herunterladen

- https://pan.quark.cn/s/f5f86d769394

- https://drive.uc.cn/s/eab589fe1a1d4

- https://pan.baidu.com/s/1c65OrFR18AuHOvTH56Yu7Q?pwd=6666

Microsoft Common Runtime Library Collection 2024.08.14

- https://pan.quark.cn/s/e4bcf05899c9

- https://pan.baidu.com/share/init?surl=hlSdsPD-H1FgD2IFanLJWA&pwd=6666

Die Laufzeitbibliothek kann auch installiert werden:Sammlung von Laufzeitumgebungen für Spielesoftware (01.10.2024) Einheitliche, verbesserte Laufzeitumgebung für Spiele

Deep Live Cam Installation

Wenn auf Ihrem Windows-Rechner eine Nvidia-Grafikkarte verbaut ist, können Sie diese direkt herunterladen und nach dem Download direkt nutzen.

Einfach herunterladen, entpacken und ausführen. Diese Version liegt als selbstextrahierendes Archiv vor, sodass keine komplizierte Installation erforderlich ist.

Hauptmerkmale

- Einfache Einrichtung: Verabschieden Sie sich von langwierigen Installationsschritten. Laden Sie es einfach herunter, entpacken Sie es und führen Sie es sofort aus.

- Optimierte Leistung: Erleben Sie flüssige Echtzeiteffekte auf kompatiblen NVIDIA-GPUs.

- Benutzerfreundliche Oberfläche: Das intuitive Design erleichtert Benutzern aller Kenntnisstufen die Verwendung.

Systemanforderungen

NVIDIA GPU: 6 GB oder mehr Videospeicher erforderlich (für optimale Leistung werden neuere Modelle empfohlen).

CUDA Toolkit 11.8.

Betriebssystem: Windows 10 oder Windows 11.

Speicher: 16 GB empfohlen.

Hinweis: Diese Version hat die gleiche Funktionalität wie die Version auf GitHub, bietet jedoch eine vereinfachte Benutzererfahrung.

Laden Sie das Deep Live Cam-Integrationspaket herunter

Laden Sie das Paket herunter. Ich habe integrierte Pakete sowohl für N- als auch für A-Karten erstellt. Wenn Ihre Grafikkarte weniger als 8 GB Videospeicher hat, laden Sie es nicht herunter!

https://pan.quark.cn/s/bad0d6cd6f0d

Laden Sie das Integrationspaket herunter und installieren Sie es

Nachfolgend finden Sie ein Installationsintegrationspaket, das die CPU-Installation und die GPU-Installation unterstützt.

Die Dateipaketgröße beträgt 6,46 GB. Das Paket enthält bereits Python und die abhängigen Pakete, ffmpeg und Installationsskripte für die vsc-Umgebung.

https://pan.baidu.com/s/1OzvIzV80rDMZALzUGazHpA?pwd=iaim

Doppelklicken Sie auf die entsprechende .bat-Startdatei, je nachdem, ob die CPU oder die GPU ausgeführt werden soll.

Nach dem Ausführen wird die Anwendungsoberfläche angezeigt. Wählen Sie links das Bild des Gesichts aus, das Sie imitieren möchten, wählen Sie rechts das Bild aus, das Sie konvertieren möchten, klicken Sie auf „Start“ (Bild konvertieren) oder klicken Sie rechts direkt auf „Live“, ohne das Bild hochzuladen.Gesichtsaustausch in Echtzeit.

Manuelle Installation von Deep Live Cam

Die manuelle Installation von Deep-Live-Cam kann bei Verwendung der CPU etwas langsam laufen, daher wird empfohlen, die GPU-Version zu verwenden.

Die Installation von Deep-Live-Cam ist relativ einfach, erfordert jedoch bestimmte Konfigurationen der Computerumgebung, darunter Python 3.10, pip, git, ffmpeg usw. Benutzer können die Installation abschließen, indem sie das GitHub-Repository klonen, die Modelldatei herunterladen und platzieren und Abhängigkeiten installieren. Die Software unterstützt mehrere Ausführungsanbieter, darunter CPU, CUDA (Nvidia GPU), CoreML (Apple Silicon), DirectML (Windows) und OpenVINO (Intel). Benutzer können die passende Ausführungslösung basierend auf ihren Hardwarebedingungen auswählen.

Voraussetzungen

- Python(3.10 wird empfohlen)

- Pip

- git

- ffmpeg

- Visual Studio 2022 Runtime (Windows)

Visual Studio 2022-Laufzeiten (Windows) Wählen Sie die gewünschte Version in Visual C++ Redistributable für Visual Studio 2022 aus

https://learn.microsoft.com/en-us/cpp/windows/latest-supported-vc-redist

Laden Sie das Installationspaket der 64-Bit-Version direkt hier herunter: https://aka.ms/vs/17/release/vc_redist.x64.exe

Installations-Tutorial für Visual Studio 2022 Professional Edition

Sie müssen das Internet wissenschaftlich nutzen. Wenn Probleme mit langsamen oder nicht verfügbaren Downloads von PyTorch auftreten, versuchen Sie es mit einem anderen Proxy-Knoten und wiederholen Sie den Vorgang.

Manuelle Installationsschritte

Die manuelle Installation ist für Experten geeignet, die gerne herumbasteln. Anfängern wird empfohlen, direkt die vorinstallierte Version zu verwenden.

Klonen Sie das Deep-Live-Cam-Projekt mit Git

Klonen Sie das GitHub-Repository, wodurch der Code des Deep-Live-Cam-Projekts auf Ihren lokalen Computer heruntergeladen wird.

Git-Klon https://github.com/hacksider/Deep-Live-Cam.git

Geben Sie das Projektverzeichnis ein, damit Sie nachfolgende Befehle in diesem Verzeichnis ausführen können

CD Deep-Live-Cam

Abhängigkeiten installieren

Erstellen Sie eine neue Conda-Umgebung „deeplivecam“ und geben Sie Python Version 3.10 an, um die Abhängigkeiten des Projekts zu isolieren.

conda create -n deeplivecam python=3.10 -y

Aktivieren Sie die soeben erstellte Conda-Umgebung, um Python auszuführen und Abhängigkeiten darin zu installieren

conda aktiviere deeplivecam

Installieren Sie die Abhängigkeiten des Projekts, die in der Datei requirements.txt aufgeführt sind

pip install -r Anforderungen.txt

Laden Sie das Modell herunter

Laden Sie die beiden Modelle in den Ordner /models im Stammverzeichnis des Projekts herunter, Download-Link:

- inswapper_128_fp16.onnx:https://huggingface.co/hacksider/deep-live-cam/resolve/main/inswapper128fp16.onnx

- HINWEIS: Wenn Probleme mit inswapper_128_fp16.onnx auftreten, verwenden Sie diese alternative Version:https://github.com/facefusion/facefusion-assets/releases/download/models/inswapper_128_fp16.onnx

- GFPGANv1.4:https://huggingface.co/hacksider/deep-live-cam/resolve/main/GFPGANv1.4.pth

- Platzieren Sie diese Dateien in einem Ordner „Modelle“.

So verwenden Sie die GPU-Version

Schritte zur Verwendung der GPU

Deinstallieren Sie die installierten onnxruntime und onnxruntime-gpu, da Sie eine bestimmte Version angeben müssen

pip deinstallieren onnxruntime onnxruntime-gpu

Installieren Sie die angegebene Version von onnxruntime-gpu, um die Kompatibilität mit der CUDA-Version des Projekts sicherzustellen

pip install onnxruntime-gpu==1.16.3

Verwenden Sie CUDA, um das Hauptskript des Projekts run.py auszuführen und die GPU-Beschleunigung zu nutzen

Python Python run.py --execution-provider cuda

So verwenden Sie die CPU-Version

Zum Starten führen Sie einfach folgenden Befehl aus:

python run.py

Anwendungsszenarien

- Ankergesichtstausch

- Video-Gesichtstausch zum Schutz der Privatsphäre