Hervorragende Software und praktische Tutorials

Verschiedene Bildraten und ihre Verwendung in Film und Video.

Bildrate Wird oft auch als Bilder pro Sekunde (fps) bezeichnet fps ) ist ein Begriff, der beschreibt, wie viele Standbilder wir in einer Sekunde sehen.FilmProduzent, dies wird eine der ersten Einstellungen sein, die Sie wählen – 24, 25, 30. 24 fps gelten allgemein als Standard für „filmische“ Bildraten. 30fps Für den Rundfunk beträgt der europäische Rundfunkstandard 25 fps.

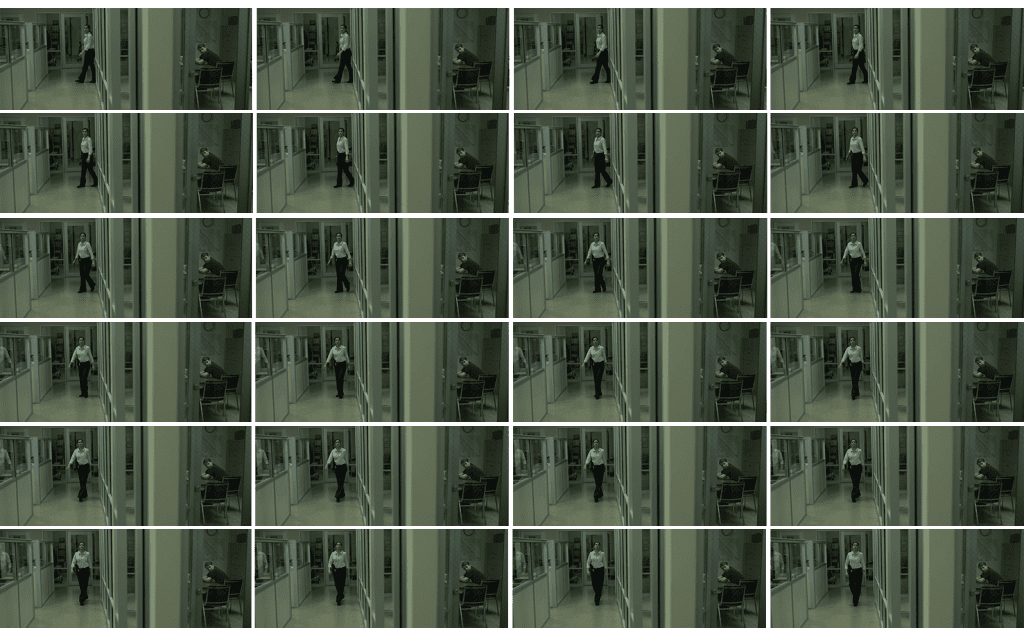

In der einsekündigen Sequenz unten werden pro Sekunde mehrere Einzelbilder angezeigt. Genauer gesagt handelt es sich um 24 Einzelbilder.

Nachfolgend unterteilen wir das Filmmaterial in einzelne Frames, wobei jeder Frame 1/24 Sekunde darstellt.

Frage zu diesem Abschnitt: Warum 24? Ich finde es sehr nützlich zu wissen, wie die Uhr tickt und nicht nur, was sie tut.vonWarum nicht 22 oder 28,59? Warum verwenden wir genau diese Bildraten? Viele Filmemacher wählen 24 fps, weil das die Standard-Bildrate ist, um ihrem Film ein filmisches Gefühl zu verleihen. Kino ist jedoch nur ein relativer Begriff für das, was wir als normal empfinden.

Sie erinnern sich vielleicht an die vielen Artikel aus dem Jahr 2013, in denen es darum ging, dass der Hobbit-Film wie ein billiger Tagesfilm aussah.FernsehdramaDas liegt daran, dass der Film mit 48 Bildern pro Sekunde gedreht wurde, was uns eine völlig andere Ästhetik vermittelt.

Warum wir24fpsEs gibt viele Gründe für das Schießen. Jahrelanges Lesen und Recherchieren zu diesem Thema haben gezeigt, dass es keinen bestimmten Grund gibt. Es ist eine Kombination verschiedener Faktoren.

Wie Menschen Frames wahrnehmen

Wir können 10 bis 12 vorbeiziehende Bilder als einzelne Bilder wahrnehmen. Je mehr Bilder pro Sekunde vorbeiziehen, desto kürzer wird der Abstand zwischen den Bildern, und unser Gehirn erkennt die Bilder als Bewegung. Dies wurde erstmals vom Psychologen Max Wertheimer dokumentiert, der den Begriff Phi prägte.

Von Anfang des 20. Jahrhunderts bis in die 1920er Jahre gab es keine branchenübliche Bildrate; es gab keine Regeln. Es lag schlicht im Interesse des Studios, die Bildrate niedrig zu halten – je höher die Bildrate, desto mehr Film musste verwendet werden – und je mehr Film verwendet werden musste, desto mehr Geld kostete es.

Während höhere Bildraten für eine bessere Bildstabilität sorgen würden, sind 16 Bilder pro Sekunde zum inoffiziellen Standard für Stummfilme geworden. Das reicht aus, um die Illusion von Bewegung zu erzeugen, und die Studiomanager verlieren nicht mit jeder Kurbelumdrehung Geld.

Es gibt verschiedene Gründe, warum man sich speziell für 24 fps entschieden hat. Im folgenden Video (von Filmmaker IQ) erklärt John P. Hess, dass die Wahl auf 24 fps fiel, weil die Einführung von Ton die Einführung einer neuen, modernen Bildraten-Standardisierung erforderlich machte.

Die Wahl von 24 Bildern pro Sekunde erfolgte aus mathematischen Gründen; die Zahl war leicht teilbar, und Cutter konnten anhand der Anzahl der Bilder spezifische Zeitschnitte berechnen. Zwölf Bilder entsprachen einer halben Sekunde, sechs Bilder einer Viertelsekunde. Stummfilme konnten zwar die Massen unterhalten, doch Filmemacher wollten ihr neues Medium weiterentwickeln. Sie wollten, dass das Publikum gesprochene Worte hörte, genau wie im Theater. Zudem bot die Einführung von Heimradios neue und spannende Geschichten, die in Film und Theater nicht möglich waren. Filmpioniere experimentierten seit Anfang des 20. Jahrhunderts mit synchronisiertem Ton. In den 1920er Jahren gelang ihnen der erste Durchbruch.

Für de Forest war dies ein Misserfolg, doch später erfand er den Phonofilm, mit dem parallel zum Film eine Lichtspur aufgezeichnet werden konnte. Diese Technik machte es physikalisch unmöglich, dass die beiden Aufnahmen nicht synchron waren, da sie im gleichen Format vorlagen.

Sie können die Briten beobachtenEnzyklopädieEin Video der Filmfirma erklärt genau, wie dieses gedruckte Klangphänomen erreicht wird.

In den 1920er Jahren trieben verschiedene Erfinder und Filmemacher die Entwicklung beider Aufnahmemedien voran. De Forest verbesserte die Audioqualität mit seinem Phonofilm, während Western Electronic und Warner Brothers mit dem unten abgebildeten Vitaphone die Grenzen der Aufnahmeformate erweiterten.

Das Vitaphone sollte jedoch den Weg für die Standardisierung der Bildfrequenz ebnen. Um de Forests Synchronisationsprobleme mit seinem Diskettenformat zu überwinden, wurden sowohl die Diskette des Vitaphone als auch die Filmprojektion mechanisch von Synchronmotoren angetrieben, die von einer gemeinsamen Stromquelle gespeist wurden. Dadurch wurde es deutlich schwieriger, dass der Ton aus der Synchronisation geriet.

Das Vitaphone sollte jedoch den Weg für die Standardisierung der Bildfrequenz ebnen. Um de Forests Synchronisationsprobleme mit seinem Diskettenformat zu überwinden, wurden sowohl die Diskette des Vitaphone als auch die Filmprojektion mechanisch von Synchronmotoren angetrieben, die von einer gemeinsamen Stromquelle gespeist wurden. Dadurch wurde es deutlich schwieriger, dass der Ton aus der Synchronisation geriet.

Die Ingenieure des Vitaphone-Systems entschieden sich für ein 16-Zoll-Diskettenformat mit einer Geschwindigkeit von 33 1/3 U/min. Bei einer Geschwindigkeit von 33 1/3 U/min hatte die Diskette eine Spieldauer von 11 Minuten. Das entspricht der Wiedergabedauer von 300 Metern Film bei einer Geschwindigkeit von 27 Metern pro Minute: 24 Bilder pro Sekunde.

Unterschiedliche Bildraten erforderten unterschiedliche Methoden der Tonaufnahme. Dies sollte sich 1927 ändern.

Die folgende Passage stammt aus Moving Image Technology: From Zoetrope to Digital:

Die Standardisierung identischer Aufnahme- und Projektionsgeschwindigkeiten ist der erste spürbare Effekt der Tonübertragung. Während die Bewegungswiedergabe in manchen Fällen über einen relativ großen Bereich variieren kann, ohne dass das ungeübte Auge dies wahrnimmt, ist dies bei der analogen Audiowiedergabe nicht der Fall, da sich mit der Geschwindigkeit der Wiedergabe auch die Tonhöhe einer Aufnahme ändert.

Im September 1927 führte das Standards and Nomenclature Committee der SMPTE eine Untersuchung durch, um die Geschwindigkeiten für die neuen Tonsysteme zu bestimmen. Die beiden bereits kommerziell genutzten Systeme (Vitaphone und Movietone) nutzten beide 24 fps. Das noch in der Entwicklung befindliche RCA-System mit variabler Zone nutzte 22 fps, während de Forest Phonofilms (zu diesem Zeitpunkt praktisch nicht mehr produziert) mit 20 fps lief. Die Trends in der Vorführpraxis des letzten Jahrzehnts und die Entscheidungen der Entwickler der beiden erfolgreichsten Tonsysteme hatten sich effektiv auf einen Standardwert von 24 fps festgelegt.

Wir können also sagen, dass 24 fps die Standardeinstellung sind, einfach weil das Vitaphone 1927 auf den Markt kam.Der JazzsängerWenn nicht, werden 22 fps wahrscheinlich der Standard für Aufnahmen sein.

FPS vs. Verschlusszeit

Verschlusszeit und Bilder pro Sekunde werden von Neulingen in diesem Medium unweigerlich verwechselt. Obwohl es sich um separate Komponenten handelt, wirken beide zusammen. Während die Bildrate die Anzahl der pro Sekunde belichteten Bilder bestimmt, bestimmt die Verschlusszeit, wie lange ein Bild belichtet wird.

So nutzen Sie FPS zur Verbesserung Ihrer Filme

Wie nutzt man Bilder pro Sekunde, um eine Geschichte zu erzählen? Die gängigste Methode hierfür ist natürlich Zeitlupe. Der alte Begriff für Zeitlupe lautet „Overcranking“ und bezieht sich auf die Zeit von Lee de Forest, als Kameraleute den Film schneller kurbelten, um die Anzahl der Bilder pro Sekunde zu erhöhen. August Musger entwickelte diese Methode Anfang des 20. Jahrhunderts.

Das obige Bild zeigt eine halbe Sekunde Filmmaterial mit 24 Bildern pro Sekunde. Bei doppelter Bildrate (48 Bilder pro Sekunde) werden in einer halben Sekunde volle 24 Bilder aufgenommen. Diese zusätzlichen Bilder werden dann als Standardbildrate interpretiert, um Zeitlupe zu erzeugen.

Was ist Herunterschalten?

Wie Sie vielleicht schon vermutet haben, ist Undercranking das Gegenteil von Zeitlupe. Es ist eine Form des Zeitraffers. Die Reduzierung der Bildanzahl pro Sekunde führt jedoch im Wesentlichen zu dem, was wir heute als Zeitrafferfotografie kennen. Standbilder aufzunehmen und sie in einen Bewegungsablauf einzupassen, ist kostengünstiger als Aufnahmen mit Film oder einer Filmkamera.

Für dramatische oder komödiantische EffektebeschleunigenVorbei sind die Zeiten, in denen die Figur verlangsamt wurde. Anders als früher, als Filme mit einer niedrigeren Bildrate als üblich gedreht und dann beschleunigt wurden, können viele Filmemacher heute mit 24 Bildern pro Sekunde drehen und die Geschwindigkeit des Filmmaterials in der Nachbearbeitung erhöhen.