優れたソフトウェアと実用的なチュートリアル

さまざまなフレーム レートと、それらが映画やビデオでどのように使用されるかについて説明します。

フレームレート フレーム/秒(fps)とも呼ばれる fps (秒)とは、1秒間に何枚の静止画像が表示されるかを表すために使用される用語です。映画プロデューサー、これが最初に選択する設定の 1 つです - 24、25、30。24fps は一般に、「映画のような」フレーム レートの標準と考えられています。 30fps 放送の場合、欧州の放送規格は25fpsです。

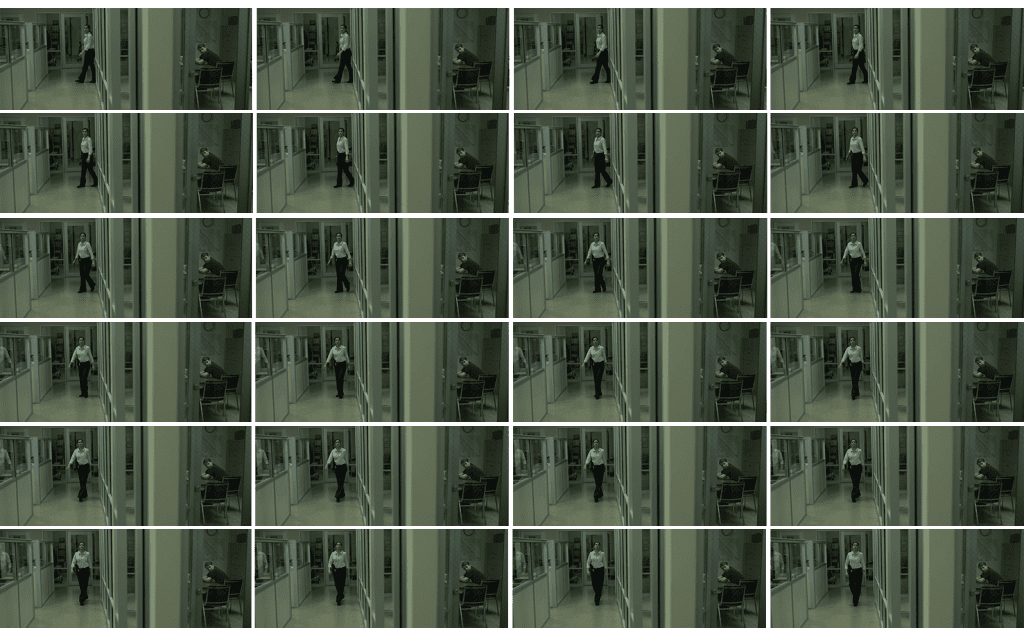

以下の1秒間のシーケンスでは、1秒ごとに複数の個別のフレームが通過します。具体的には、24枚の個別の静止画があります。

以下では、映像を個別のフレームに分割します。各フレームは 1/24 秒を表します。

このセクションの質問: なぜ 24 なのですか? 時計が何をしているかだけではなく、どのように進んでいるかを知ることは非常に役立つと思います。のなぜ22fpsや28.59fpsではないのでしょうか?なぜこれらのフレームレートを採用するのでしょうか?多くの映画製作者は、映画に「映画のような」雰囲気を与えるための標準的なfpsとして24fpsを選択します。しかし、映画とは、私たちが普通に見えていると考える相対的な用語に過ぎません。

2013年に公開された多くの記事で、ホビットの映画が安っぽい昼間の映画のようだと書かれていたことを覚えている人もいるかもしれない。テレビドラマこれは 48fps で撮影されたため、まったく異なる美的感覚が得られるからです。

なぜ私たちは24fps射撃には様々な理由があり、長年にわたるこのテーマに関する文献や研究に基づくと、特定の理由というものは存在しません。複数の要因が組み合わさって生じているのです。

人間がフレームを認識する方法

私たちは10~12枚のフレームを、それぞれ異なる画像として認識することができます。毎秒、より多くの画像が通過するにつれて、各画像間の間隔は短くなり、脳は画像を動きとして認識します。これは心理学者マックス・ヴェルトハイマーによって初めて記録され、「ファイ」という用語が生まれました。

1900年代初頭から1920年代にかけて、業界標準のフレームレートは存在せず、ルールもありませんでした。スタジオにとっては、フレームレートを低く抑えることが最善の利益だったのです。フレームレートが高ければ高いほど、使用するフィルムの量が増え、使用するフィルムの量が増えれば増えるほど、コストも増加しました。

フレームレートを高くすれば映像の残像感は向上するが、無声映画では16fpsが非公式の標準となっている。動いているような錯覚を生み出すには十分であり、スタジオの幹部は手回しクランクを回すたびに資金を失うわけではない。

24fpsが特に選ばれた理由には様々な説があります。以下のビデオ(Filmmaker IQ提供)では、ジョン・P・ヘス氏が、サウンドの導入により、新たな現代的なフレームレートの標準化が必要になったため、24fpsが選ばれたと説明しています。

24fpsが選ばれたのは数学的な理由からです。割り切れる数字であり、編集者はフレーム数に基づいて具体的なカットタイムを計算できました。12フレームは0.5秒、6フレームは0.4秒です。無声映画は大衆を楽しませることができましたが、映画製作者たちはこの新しいメディアをさらに進化させたいと考えました。彼らは観客に、劇場のように語りを聞かせたいと考えました。さらに、家庭用ラジオの登場により、映画や劇場では味わえない、新しく刺激的なストーリーが提供されるようになりました。映画製作のパイオニアたちは1900年代初頭から同期音声の実験を続け、1920年代に最初の飛躍的な進歩を遂げました。

これはド・フォレストにとって失敗に終わったが、後に彼はフォノフィルムを発明し、フィルムと並行して光の軌跡を記録する手法を導入した。この技術により、両者は同じフォーマットであったため、同期がずれることは物理的に不可能になった。

イギリスの百科事典この印刷されたサウンド現象がどのように実現されるかを詳しく説明した映画会社のビデオ。

1920年代を通して、様々な発明家や映画製作者たちが、両方の録音媒体の発展に尽力しました。ド・フォレストはフォノフィルムで音質の向上を図り、ウェスタン・エレクトロニックとワーナー・ブラザースはヴァイタフォン(下図)で録音ディスクフォーマットの限界を押し広げました。

しかし、ヴァイタフォンはフレームレート標準化の先駆けとなるはずでした。ド・フォレストがディスクフォーマットで抱えていた同期問題を克服するため、ヴァイタフォンのディスクと映写機は、共通の電源で駆動する同期モーターによって機械的に駆動されました。これにより、音声の同期ずれが大幅に軽減されました。

しかし、ヴァイタフォンはフレームレート標準化の先駆けとなるはずでした。ド・フォレストがディスクフォーマットで抱えていた同期問題を克服するため、ヴァイタフォンのディスクと映写機は、共通の電源で駆動する同期モーターによって機械的に駆動されました。これにより、音声の同期ずれが大幅に軽減されました。

Vitaphoneシステムのエンジニアたちは、33 1/3回転で再生できる16インチのディスクフォーマットを採用しました。33 1/3回転でディスクを回転させると、再生時間は11分になります。これは、1,000フィートのフィルムを毎分90フィート(24フレーム/秒)で再生する場合と同じ時間です。

映画のフレームレートの違いによって、音声の録音方法も異なっていました。しかし、これは1927年に変化しました。

以下の文章は『動画技術:ゾエトロープからデジタルへ』より抜粋したものです。

音声への変換によって最初に目に見える効果は、撮影速度と投影速度の統一です。動きの再現は、場合によっては、訓練されていない目には気づかれないほどかなり広い範囲で変化しますが、アナログ音声の再現では、録音の再生速度を変えるとピッチも変化するという単純な理由から、変化しません。

1927年9月、SMPTEの規格・命名委員会は、当時台頭しつつあった音響システムでどの速度を採用すべきか、実態調査を行いました。当時すでに商用化されていた2つのシステム(VitaphoneとMovietone)は、どちらも24fpsを採用していました。当時開発中だったRCAの可変ゾーンシステムは22fps、そしてde Forest Phonofilms(当時は事実上生産中止)は20fpsでした。これを踏まえると、過去10年間の上映業界の動向と、最も成功した2つの音響システムの設計者による決定により、事実上24fpsが標準規格として定着したことになります。

つまり、Vitaphone が 1927 年に発売されたという理由だけで、24fps がデフォルトであると言えます。ジャズシンガーそうでなければ、22fpsが撮影の標準になるでしょう。

FPSとシャッタースピード

シャッタースピードと1秒あたりのフレーム数は、このメディアに初めて触れる人にとっては必然的に混同されがちです。これらは別々の要素ですが、連携して機能します。フレームレートは1秒間に露光されるフレーム数を決定するのに対し、シャッタースピードは1フレームの露光時間を決定します。

FPSを活用して映画を制作する方法

ストーリーを伝えるために、1秒あたりのフレーム数をどのように活用するのでしょうか?最も一般的な方法は、もちろんスローモーションです。スローモーションの古い用語は「オーバークランキング」で、リー・ド・フォレストの時代に遡ります。当時、カメラマンはフィルムを高速で巻き上げ、1秒あたりのフレーム数を増やしていました。これは20世紀初頭にオーガスト・マスガーによって初めて考案されました。

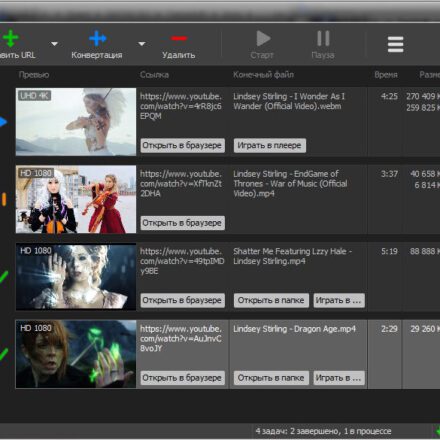

上の画像は、24fpsで0.5秒間の映像です。フレームレートを2倍(48fps)で撮影すると、0.5秒間に24フレームを撮影することになります。これらの追加フレームは、スローモーション撮影の標準フレームレートとして解釈されます。

ダウンシフトとは何ですか?

ご想像のとおり、アンダークランクはスローモーションの逆で、ファストモーションの一種です。しかし、1秒あたりのフレーム数を減らすという行為は、本質的にはタイムラプス撮影と呼ばれるものになります。静止画を撮影し、それをモーションシーケンスに合成する手法は、フィルムや映画用カメラで撮影するよりも費用対効果が高いのです。

ドラマチックな効果やコメディ効果を出すため加速するキャラクターのスピードを落とす時代は終わりました。映画を通常よりも低いフレームレートで撮影し、その後スピードアップさせていた時代とは異なり、多くの映画製作者は24fpsで撮影し、ポストプロダクションで映像のスピードを上げることができます。